deepseek+AnythingLLM搭建自己的知识库大模型

什么是RAG:翻译为检索增强生成,nomic-embed-text模型是一个文本嵌入模型,目的帮助我们把知识库文本embedded成模型能读懂的格式,感兴趣的可以去学习一下自然语言处理相关知识。当部署完自己的本地deepseek后,我们想用自己的数据训练一下自己的模型,需要怎么做呢,本篇就来介绍一下我是怎么做的,还没安装的参考上一篇内容。选择一个deepseek模型,为了快,我选择的是1.5b,跑

目录

友情提示

当部署完自己的本地deepseek后,我们想用自己的数据训练一下自己的模型,需要怎么做呢,本篇就来介绍一下我是怎么做的,还没安装的参考上一篇内容

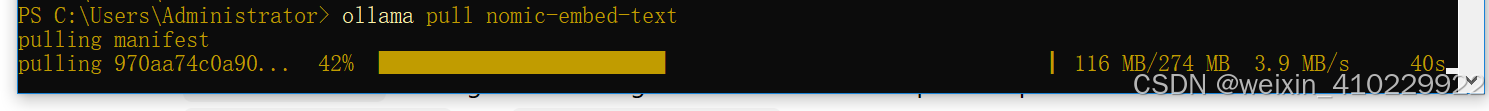

下载RAG模型

什么是RAG:翻译为检索增强生成,nomic-embed-text模型是一个文本嵌入模型,目的帮助我们把知识库文本embedded成模型能读懂的格式,感兴趣的可以去学习一下自然语言处理相关知识

ollama pull nomic-embed-text

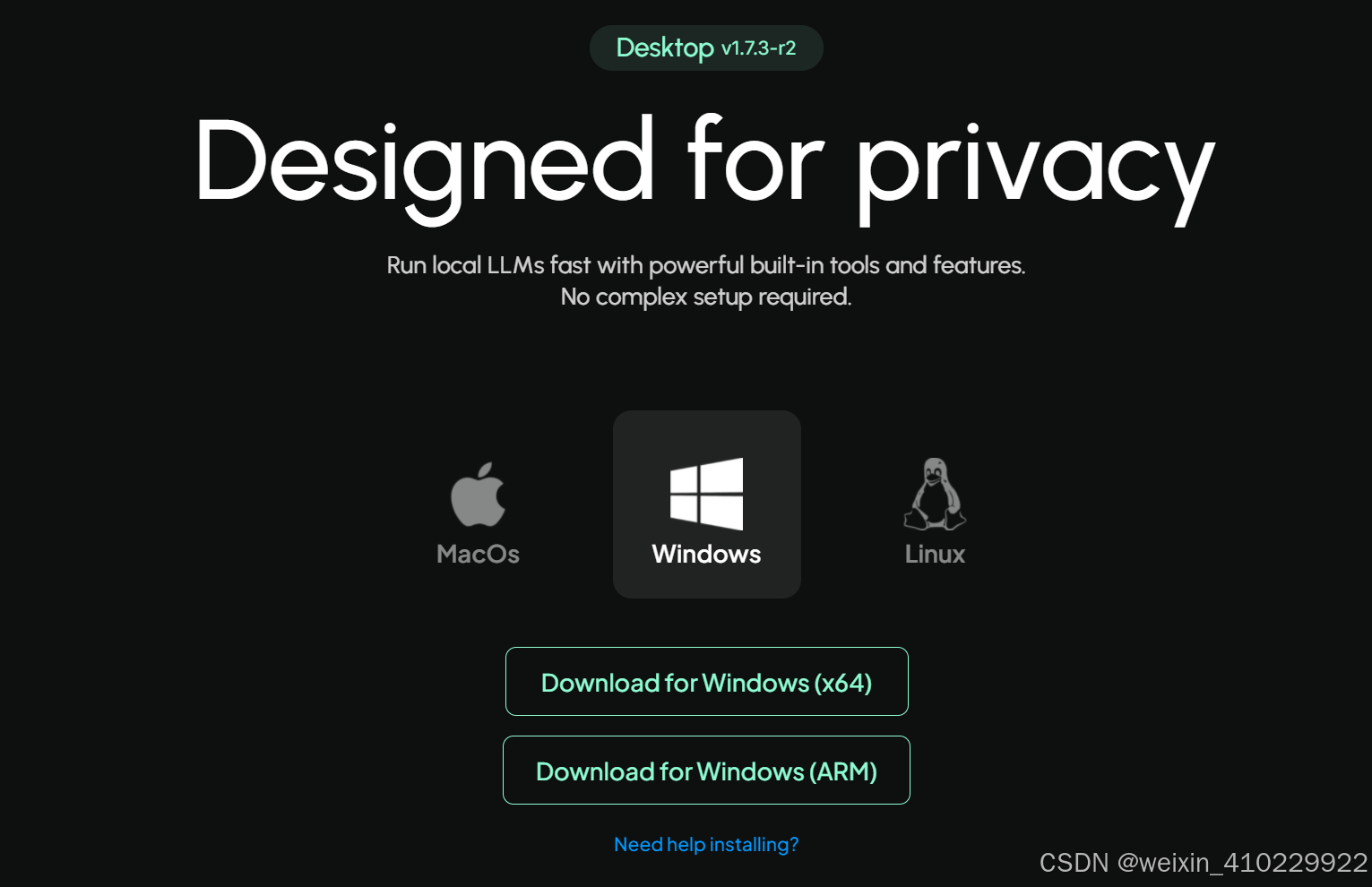

安装AnythingLLM

什么是LLM,可以理解为给我们开发好的客户端,直接调用本地的模型,方便我们直接使用功能

打开AnythingLLM官网:https://anythingllm.com

按照自己电脑系统进行下载:

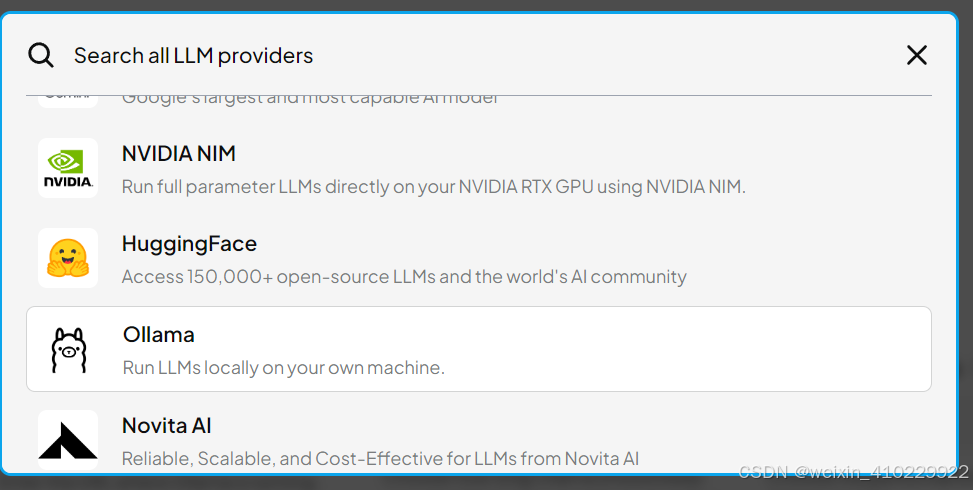

安装完进入,选择Ollama

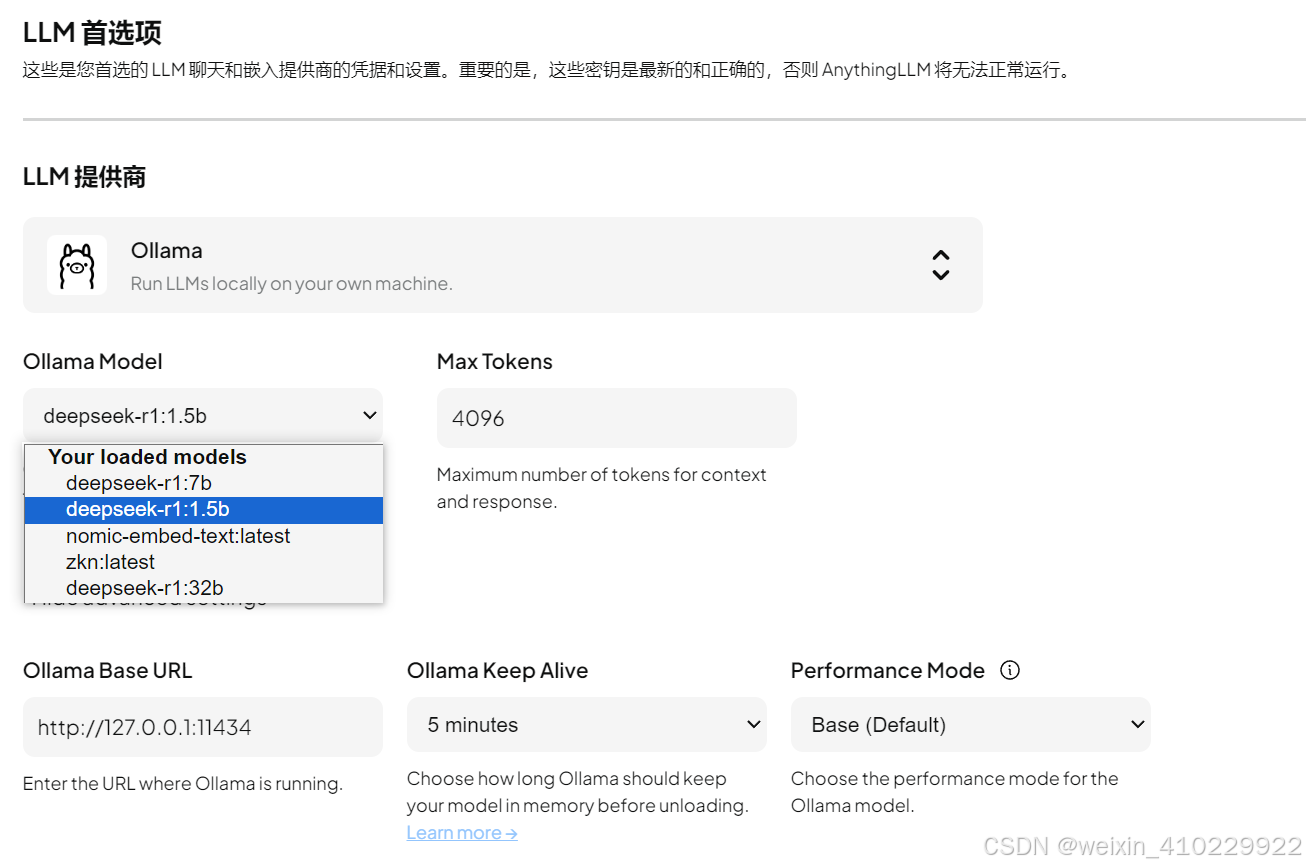

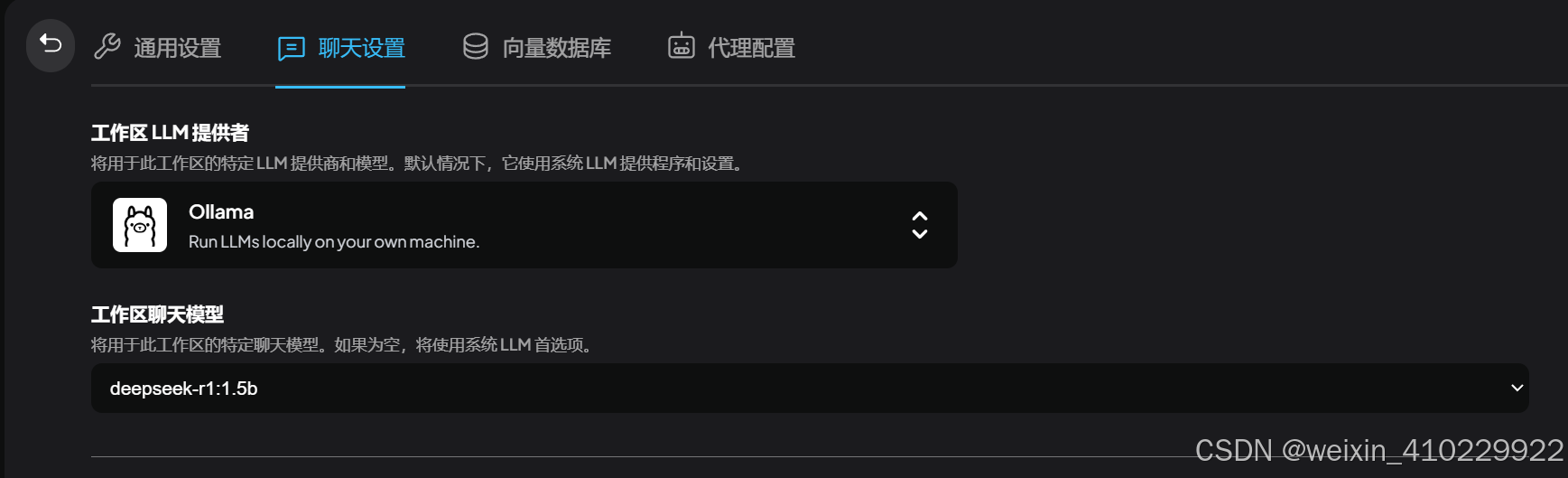

选择一个deepseek模型,为了快,我选择的是1.5b,跑32b确实有些吃力,速度太慢了

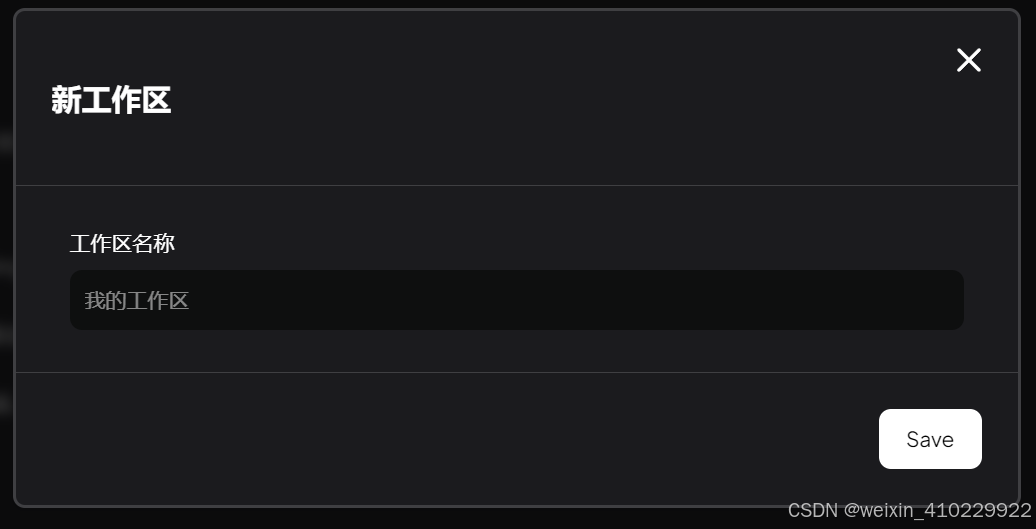

一个工作区相当于一个docker,名字任意

创建本地知识库

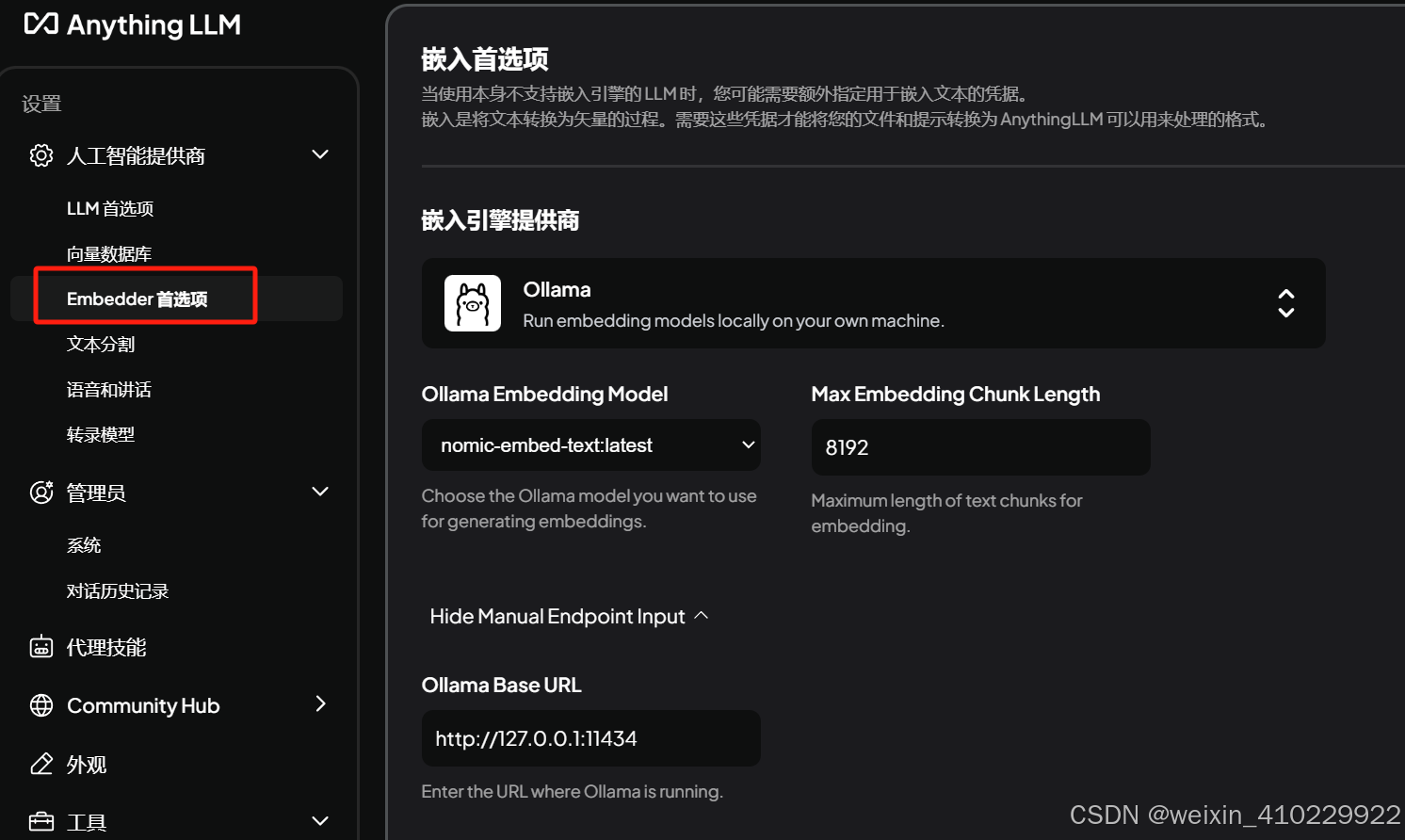

设置选项里找到Embedder首选项,选择Ollama,nomic-embed-text模型

设置完右上角记得保存

聊天设置同上

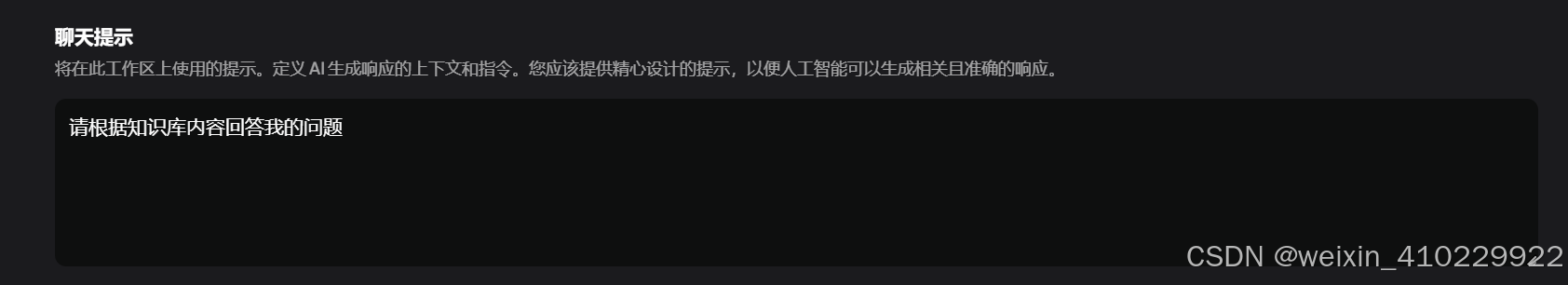

提示词写按照知识库回答就可以了

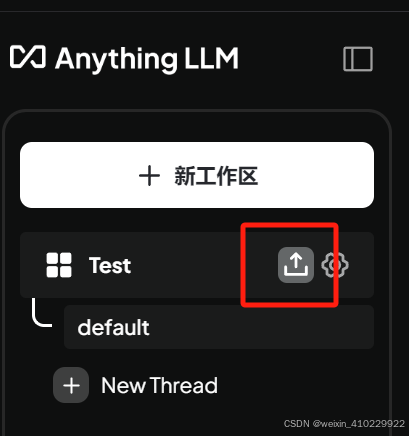

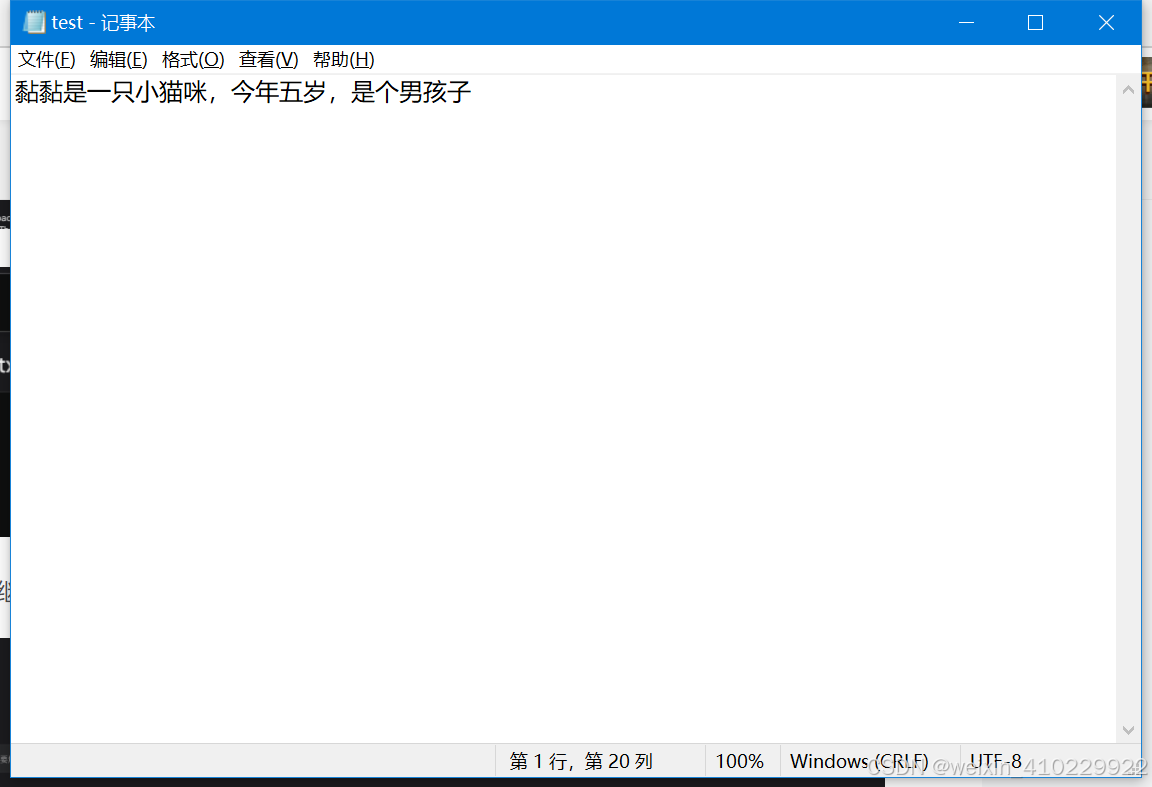

返回工作区,点击上传按钮

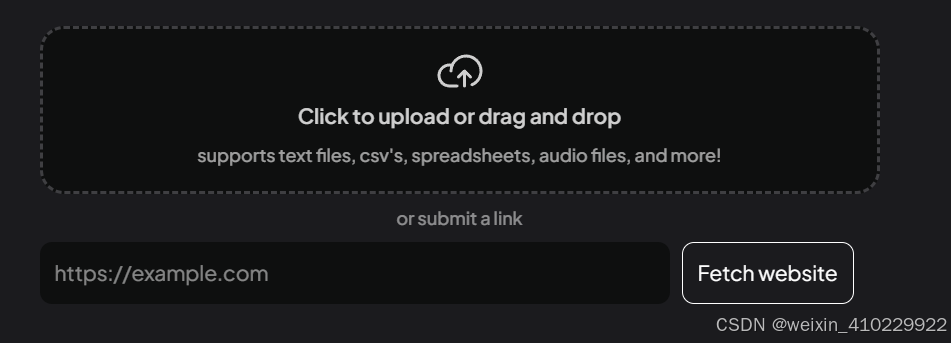

可以选择上传文件,或者可以在下面的Fetch Website中输入网址

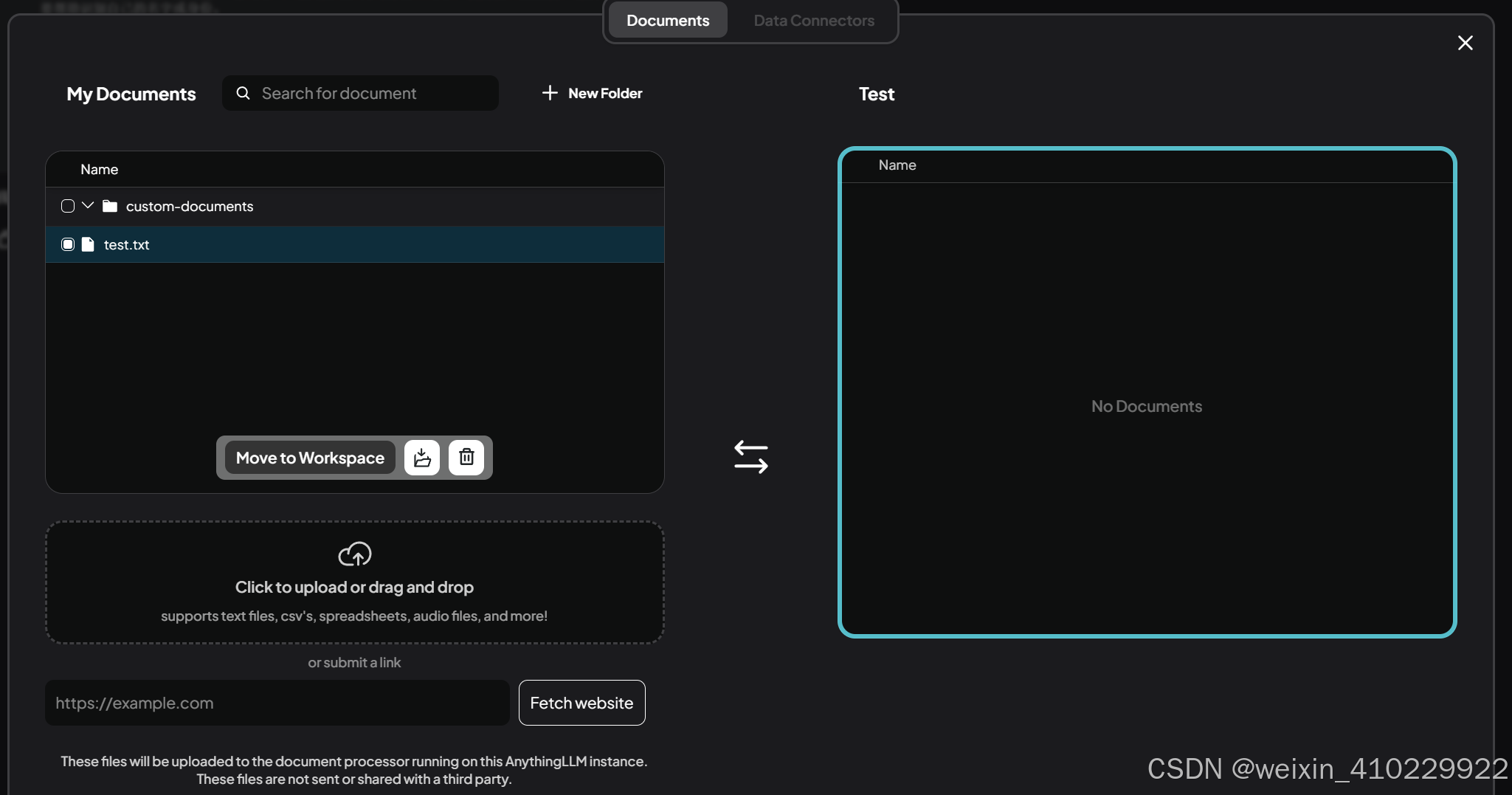

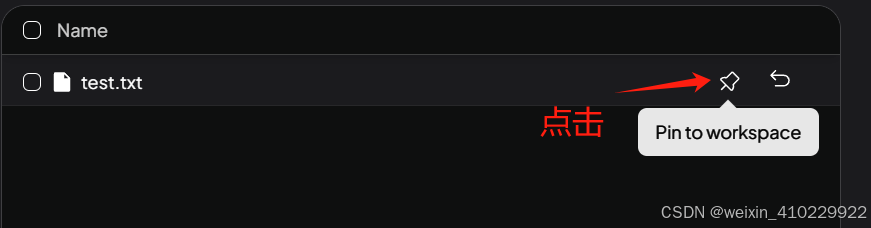

转移至工作空间

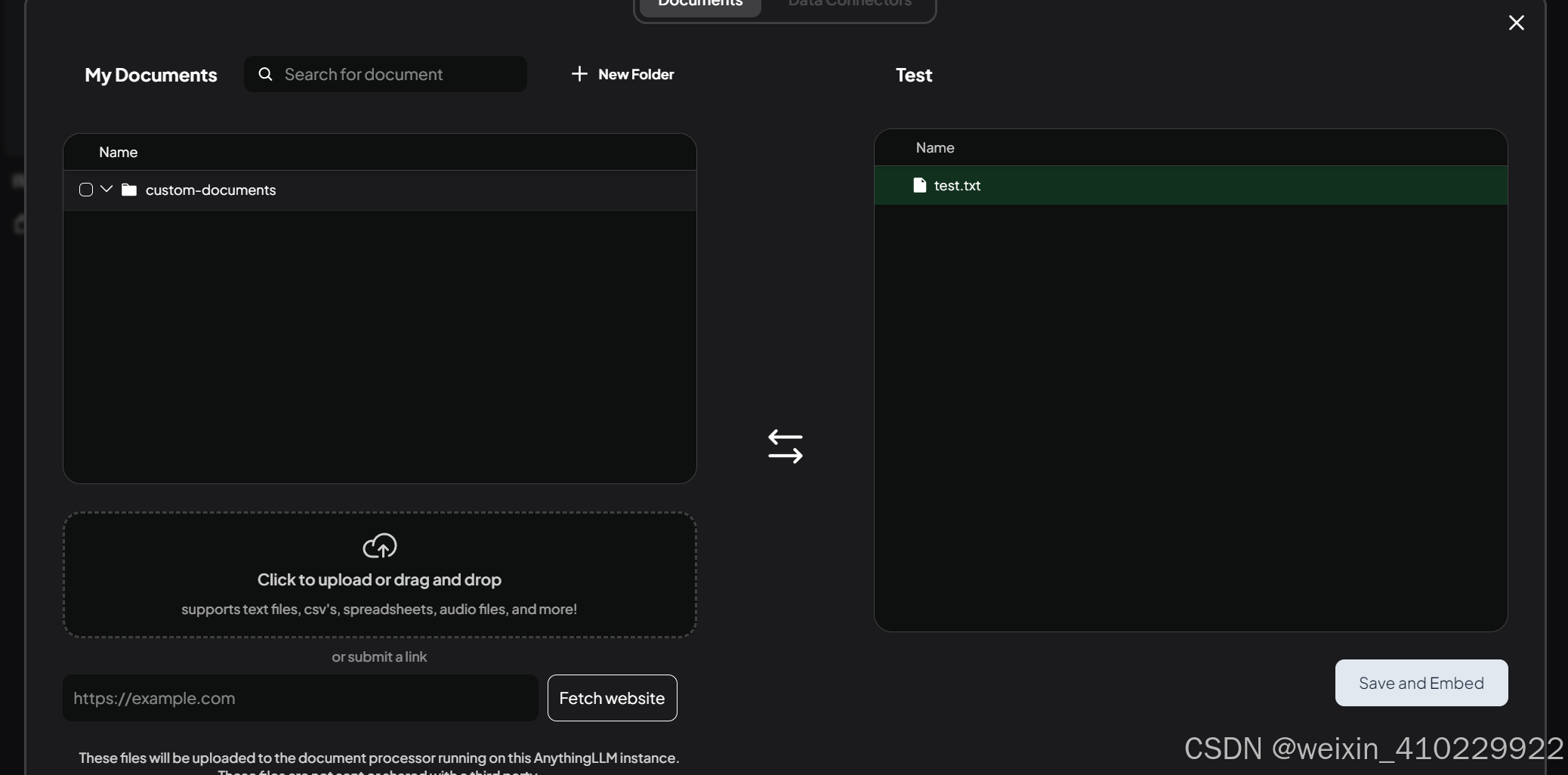

右下角保存

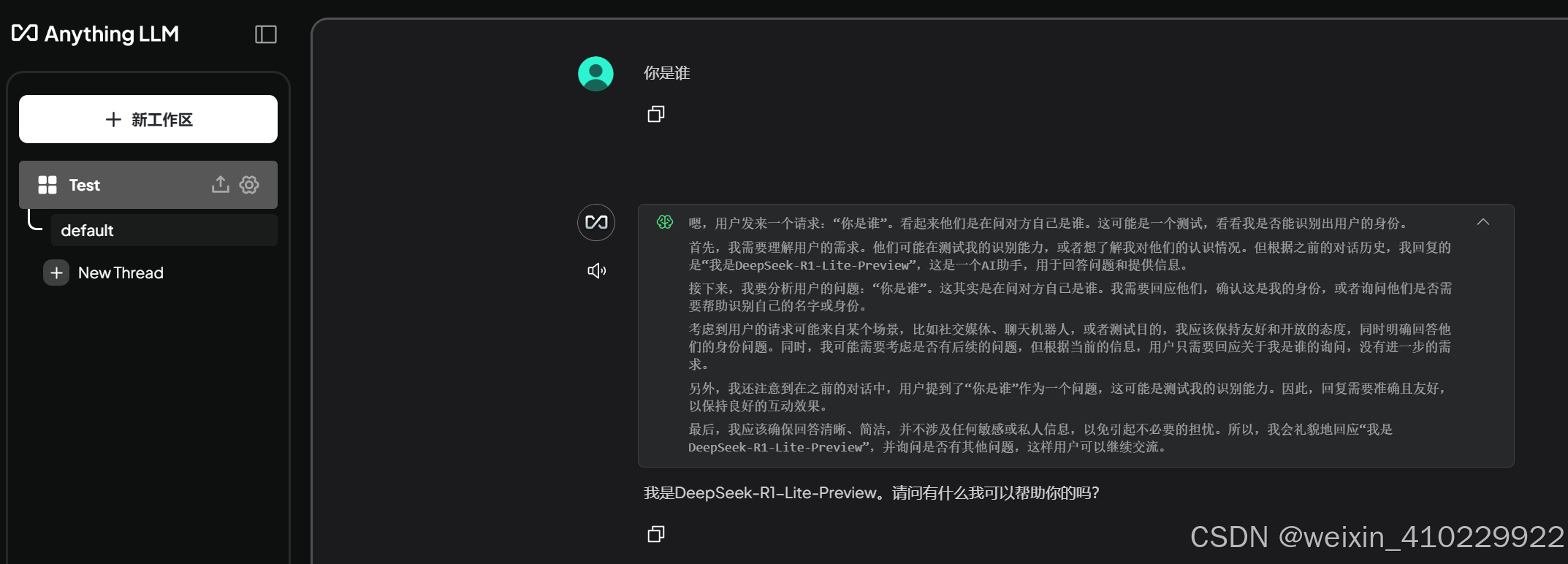

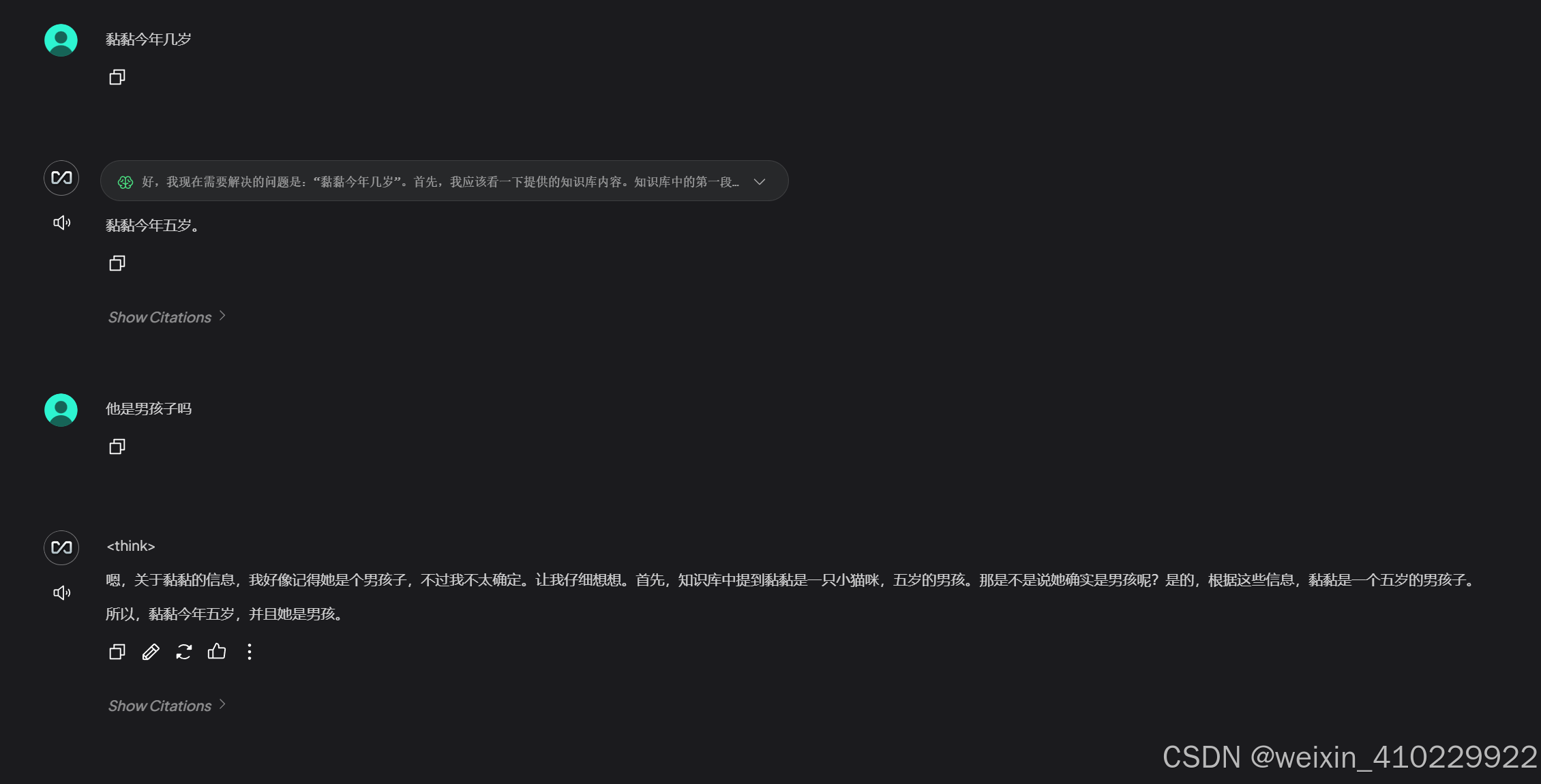

根据test内容,回到聊天页面继续提问

搞定!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)