Ollama框架结合docker下的open-webui与AnythingLLM构建RAG知识库

Ollama框架结合open-webui与AnythingLLM构建RAG知识库(Building an RAG Knowledge Library using Ollama, open-webui, and AnythingLLM)

Ollama框架结合open-webui与AnythingLLM构建RAG知识库(Building an RAG Knowledge Library using Ollama, open-webui, and AnythingLLM)

在人工智能领域,大型语言模型(LLM)如ChatGPT等已经展现出强大的能力。然而,这些模型在特定领域的应用中存在局限性,如知识更新不及时、数据安全性问题等。RAG(检索增强生成)技术通过结合LLM和外部知识库,有效解决了这些问题,提高了模型的准确性和可靠性。本文将手把手教你,在本地部署属于自己的大模型。

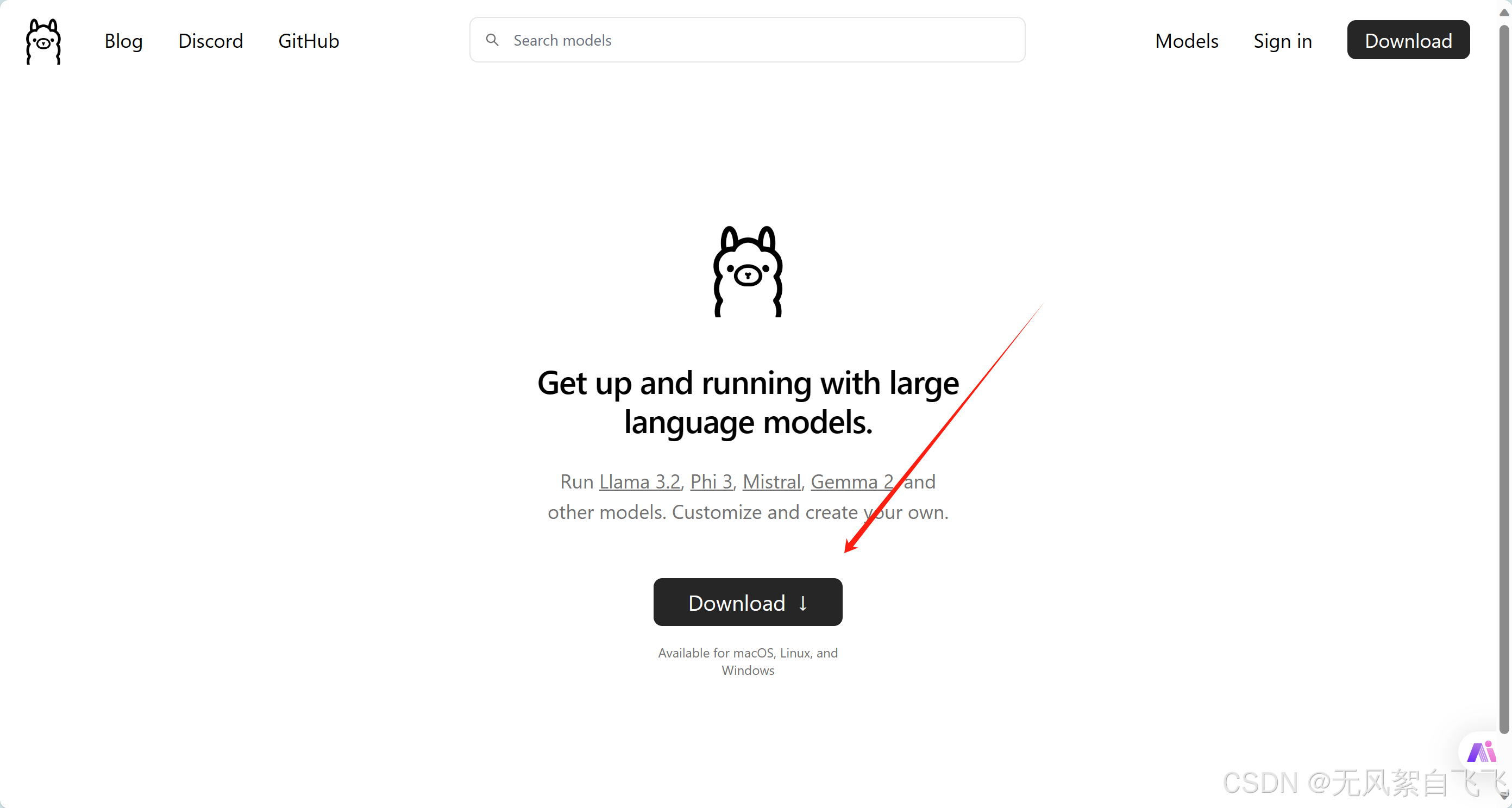

一、安装Ollama

Ollama的安装过程简单直观,支持Windows、Mac和Linux操作系统。用户只需通过命令行执行简单的安装命令,即可完成Ollama的安装。安装完成后,通过执行ollama -V命令来验证安装是否成功。接下来,用户可以根据自己的需求下载并部署不同的模型,如7B、13B或70B等,以进行本地部署和测试。

访问Ollama官网链接:https://ollama.com/

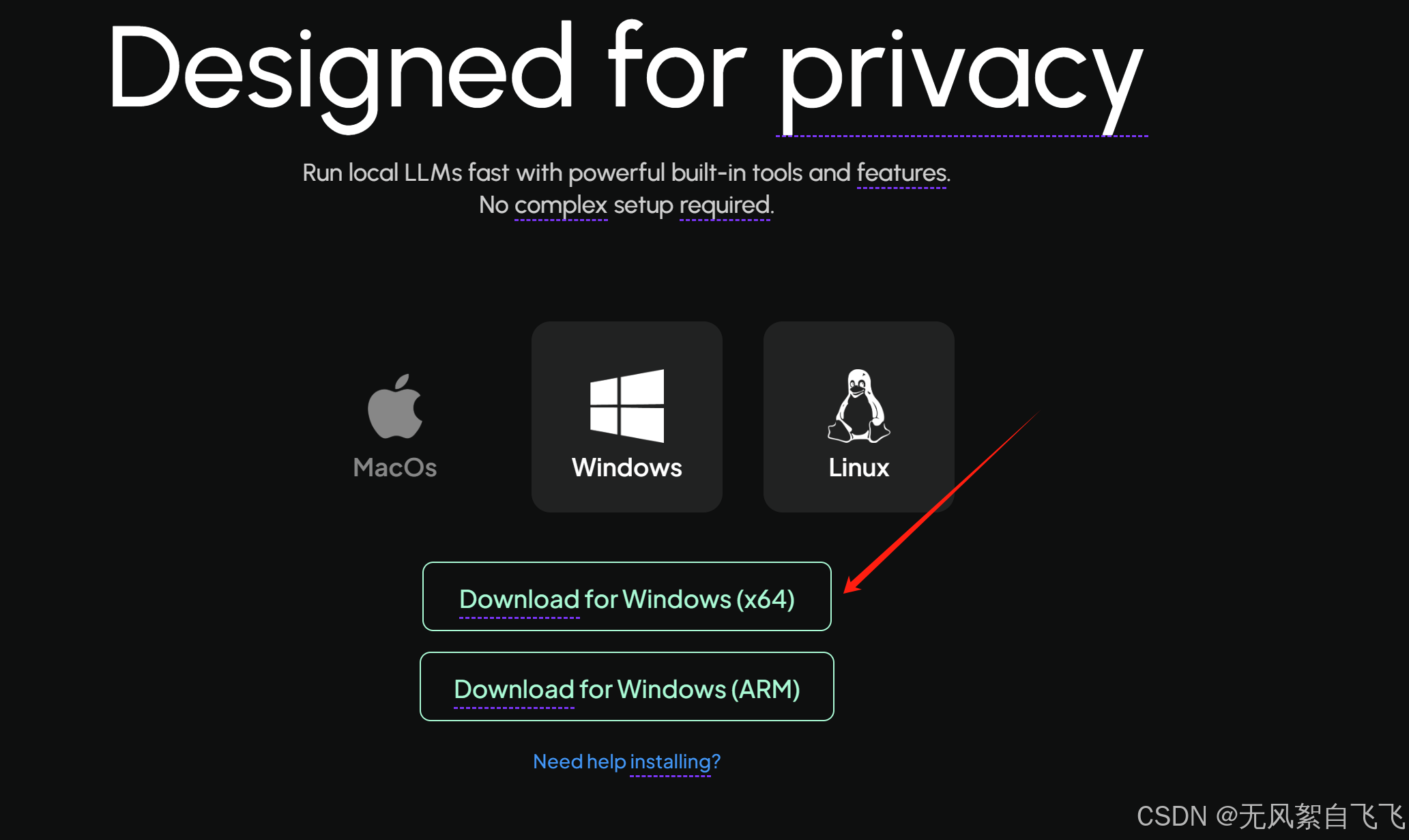

点击下载,选择适合自己电脑版本的:

下载安装后,选择适合自己电脑配置的模型库: https://ollama.com/library

我这里选择的是llama3:8b

在终端输入

ollama run llama3:8b

等待下载完后输入 ollama list 就会出现你的模型名称。至此,ollama下载成功。

下面是测试:

下面是测试:

当然,如果你只在CMD终端交互,那么就没有本地大模型体验感了,这时,就需要一个交互界面了。AnythingLLM或者Open WebUI集成

二、AnythingLLM介绍与安装

AnythingLLM是由Mintplex Labs开发的全栈应用程序,它不仅支持多种文档类型,如PDF、TXT、DOCX等,还提供了对话和查询两种聊天模式,以适应不同的业务需求。作为一个企业级的文档聊天机器人解决方案,AnythingLLM可以在本地运行,也可以远程托管,为用户提供了灵活的部署选项。安装AnythingLLM涉及下载桌面应用或通过Docker进行部署,并进行配置,包括选择LLM模型、嵌入模型和向量数据库等关键组件。

直接去官网安装符合自己电脑配置的版本:Download AnythingLLM for Desktop

我的是X86的

按照指引进行安装,接下来就是ollama的配置

测试

三、Open WebUI集成

为了提供更好的用户交互体验,Open WebUI作为一个现代的聊天窗口界面,可以与Ollama和AnythingLLM集成。用户可以通过Docker轻松安装Open WebUI,并将其与后端的Ollama和AnythingLLM服务集成,从而创建一个完整的本地知识库系统。这种集成不仅提升了用户体验,还使得知识库的管理更加直观和便捷。

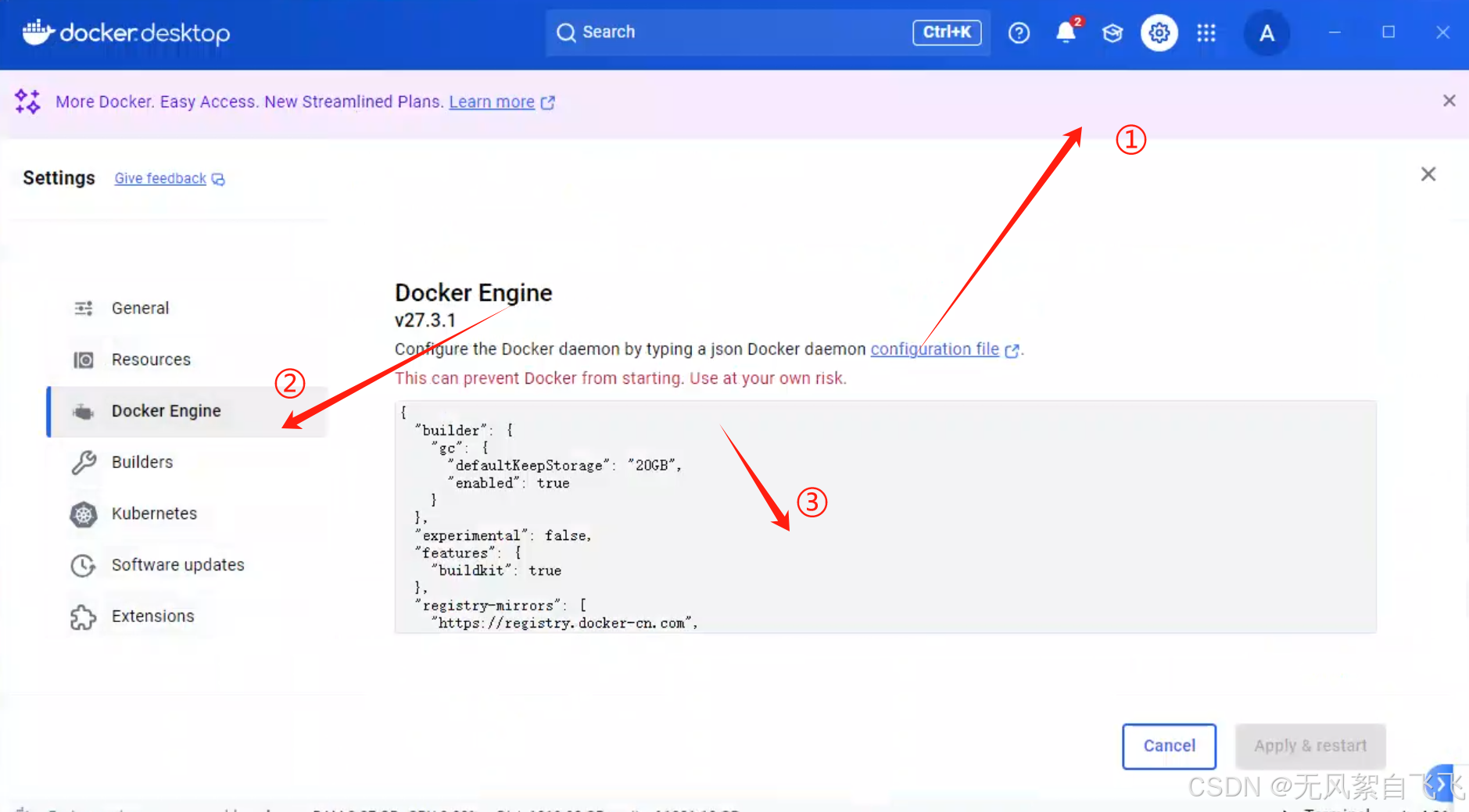

3.1 docker安装

这时,你要先下载docker。 你可以将他理解成一个容器。

下载链接:Docker Desktop: The #1 Containerization Tool for Developers | Docker

下载后按提示进行安装。

进入后,按如下操作进行换源

3.2 在docker下拉取openWeb UI

openWeb UI 的链接 https://github.com/open-webui/open-webui

下拉找到

将下面命令在终端输入

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

顺利的话,个把小时,就好了。我当时用了大约4个小时。失败了没关系,多试几次。

点击后:

至此,open WebUI 配置成功。测试如下:

四、构建RAG知识库

构建RAG知识库是一个涉及数据准备和应用两个阶段的过程。在数据准备阶段,需要将企业的私域数据进行向量化处理,并构建索引,以便后续的高效检索。这一步骤是知识库构建的基础,直接影响到检索的准确性和效率。在应用阶段,系统通过高效的检索方法召回与用户提问最相关的知识,并将其融入到模型的Prompt中,利用LLM生成准确的回答。

注:在安装过程中有点地方比较卡,需要科学上网。当然,如果想省去下载的蛮烦,可以后台丝我,分享给你这三个安装包。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)